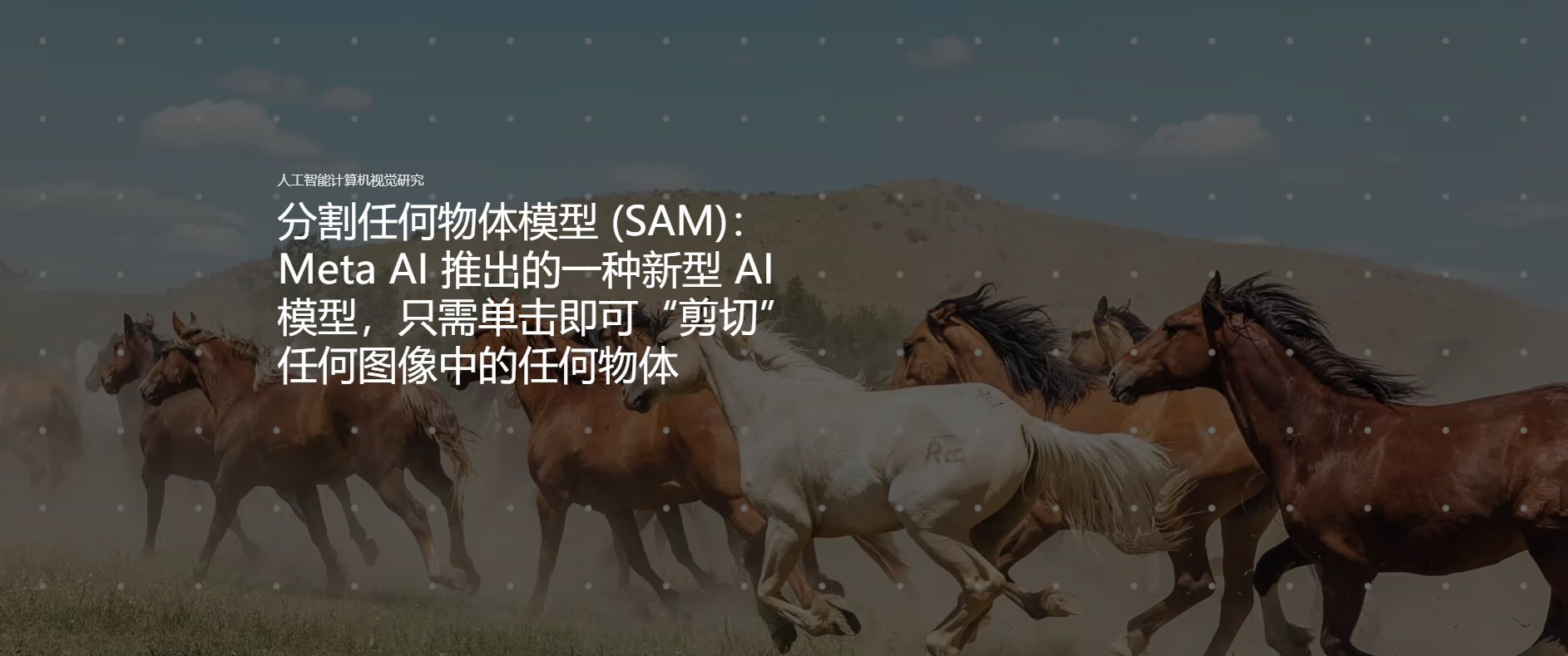

Meta Al 圖像切割服務

專用API

【更新時間: 2024.08.13】

"Meta AI"是Meta公司的人工智能研究部門,致力于推動人工智能領域的創(chuàng)新和突破。該部門專注于開發(fā)先進的人工智能技術和算法,包括自然語言處理、計算機視覺、增強現(xiàn)實/虛擬現(xiàn)實(AR/VR)、機器人技術等多個領域。

|

瀏覽次數(shù)

34

采購人數(shù)

0

試用次數(shù)

0

SLA: N/A

SLA: N/A

響應: N/A

響應: N/A

適用于個人&企業(yè)

適用于個人&企業(yè)

試用

收藏

×

完成

取消

×

書簽名稱

確定

|

- API詳情

- 常見 FAQ

- 關于我們

- 相關推薦

什么是Meta Al 圖像切割服務?

"Meta AI"是Meta公司的人工智能研究部門,致力于推動人工智能領域的創(chuàng)新和突破。該部門專注于開發(fā)先進的人工智能技術和算法,包括自然語言處理、計算機視覺、增強現(xiàn)實/虛擬現(xiàn)實(AR/VR)、機器人技術等多個領域。Meta AI 旨在通過其研究來推動技術邊界,并將這些技術應用于Meta的產(chǎn)品和服務中,同時也開放一些研究成果供學術界和工業(yè)界使用。

Meta Al 圖像切割服務有哪些核心功能?

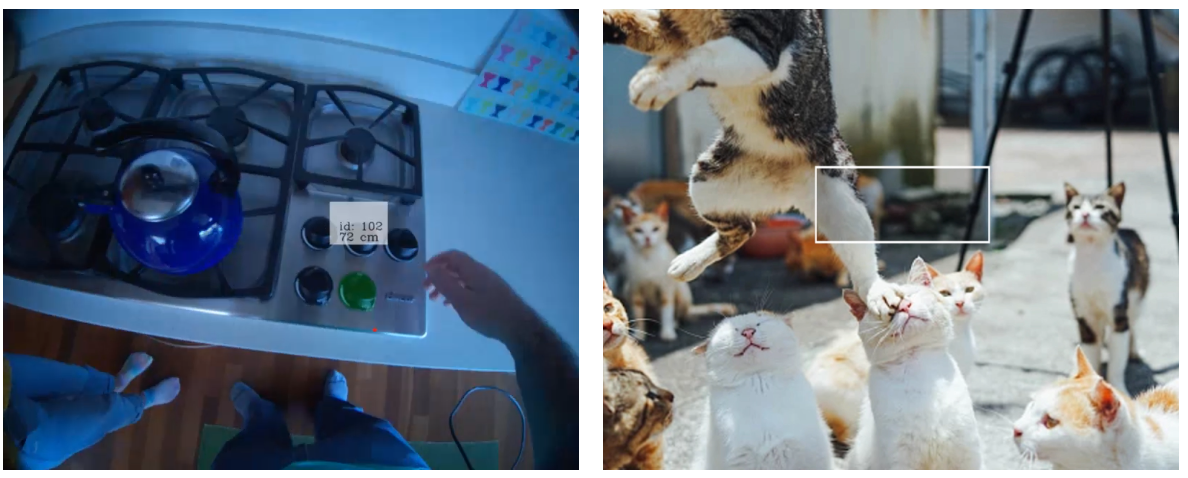

1. SAM 使用多種輸入提示

指定在圖像中分割的內容的提示允許執(zhí)行廣泛的分割任務,而無需額外的訓練。用交互點和框來提示它。自動分割圖像中的所有內容。為模糊提示生成多個有效的掩碼。 2. SAM 的提示式設計可實現(xiàn)與其他系統(tǒng)的靈活集成

2. SAM 的提示式設計可實現(xiàn)與其他系統(tǒng)的靈活集成

SAM 可以從其他系統(tǒng)獲取輸入提示,例如將來可以從 AR/VR 耳機獲取用戶的注視來選擇對象。此視頻使用了我們開源的 Aria 試點數(shù)據(jù)集。

來自對象檢測器的邊界框提示可以實現(xiàn)文本到對象的分割。 3. 可擴展輸出

3. 可擴展輸出

輸出蒙版可用作其他 AI 系統(tǒng)的輸入。例如,對象蒙版可在視頻中跟蹤、啟用圖像編輯應用程序、提升為 3D或用于拼貼等創(chuàng)意任務。 4. 零樣本泛化

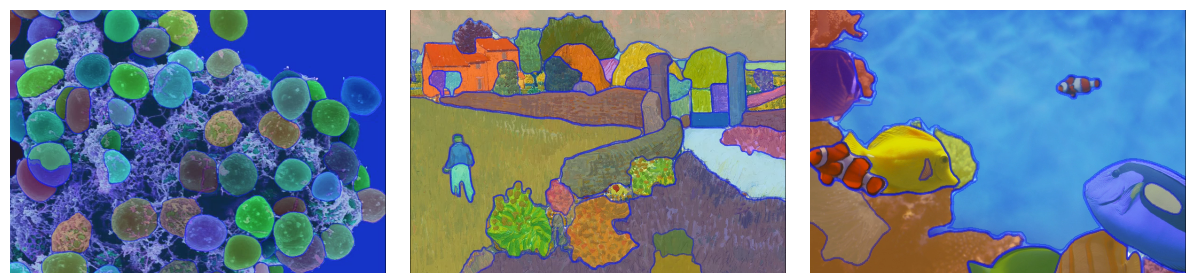

4. 零樣本泛化

SAM 已經(jīng)學會了關于物體的一般概念——這種理解使得零樣本泛化到不熟悉的物體和圖像而無需額外的訓練。

Meta Al 圖像切割服務的核心優(yōu)勢是什么?

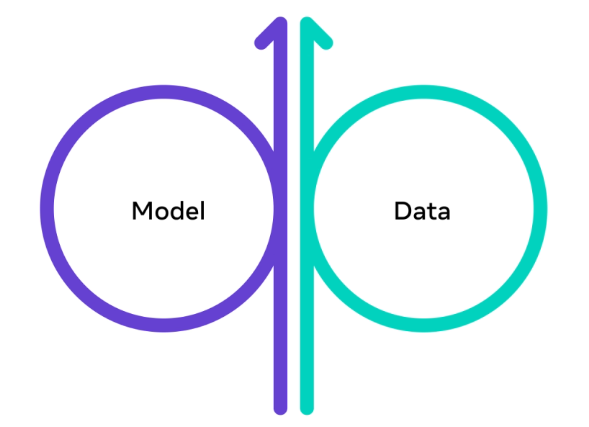

1. SAM 的數(shù)據(jù)引擎

SAM 的先進功能源自其對數(shù)百萬張圖像和掩碼的訓練,這些圖像和掩碼是通過使用模型在環(huán)“數(shù)據(jù)引擎”收集的。研究人員使用 SAM 及其數(shù)據(jù)以交互方式注釋圖像并更新模型。這個循環(huán)重復多次,以改進模型和數(shù)據(jù)集。 2. 1100 萬張圖像,10 億多張掩膜

2. 1100 萬張圖像,10 億多張掩膜

在 SAM 的幫助下注釋了足夠多的蒙版后,我們能夠利用 SAM 復雜的模糊感知設計完全自動注釋新圖像。為此,我們向 SAM 展示圖像上的點網(wǎng)格,并要求 SAM 在每個點處分割所有內容。我們的最終數(shù)據(jù)集包括從約 1100 萬張獲得許可和隱私保護的圖像中收集的超過 11 億個分割蒙版。 3. 高效靈活的模型設計

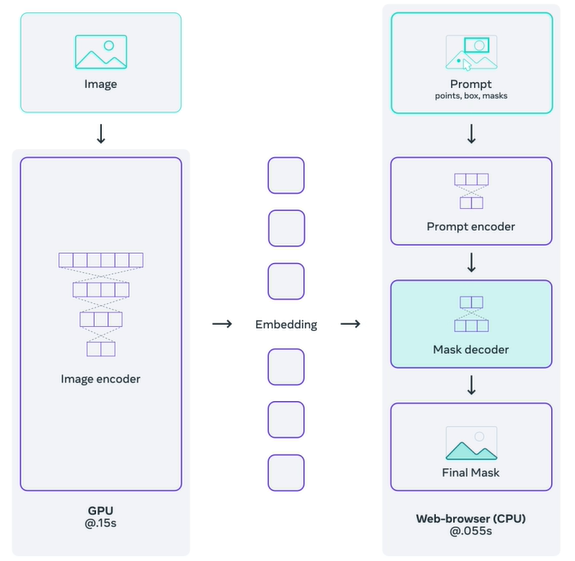

3. 高效靈活的模型設計

SAM 的設計足夠高效,能夠為其數(shù)據(jù)引擎提供動力。我們將模型分解為 1) 一次性圖像編碼器和 2) 輕量級掩碼解碼器,每次提示只需幾毫秒即可在網(wǎng)絡瀏覽器中運行。

在哪些場景會用到Meta Al 圖像切割服務?

- 圖像和視頻編輯:

- 在圖像和視頻編輯軟件中,用戶可以使用SAM來快速分割出圖像中的特定對象,用于替換背景、裁剪、縮放或其他編輯操作。

- 在視頻處理中,SAM可以用于跟蹤視頻中的對象,并應用于特效添加、視頻合成等場景。

- 增強現(xiàn)實/虛擬現(xiàn)實(AR/VR):

- 在AR/VR應用中,SAM可以與用戶的交互(如注視點、手勢等)結合,實現(xiàn)更自然的對象選擇和分割,提升用戶體驗。

- 在虛擬現(xiàn)實環(huán)境中,SAM可以用于場景重建、物體放置和交互等。

- 圖像識別和分析:

- 在醫(yī)療領域,SAM可以用于醫(yī)學影像分析,如自動分割出病灶區(qū)域,輔助醫(yī)生進行診斷。

- 在安防領域,SAM可以用于監(jiān)控視頻中的目標檢測和跟蹤,提高監(jiān)控效率。

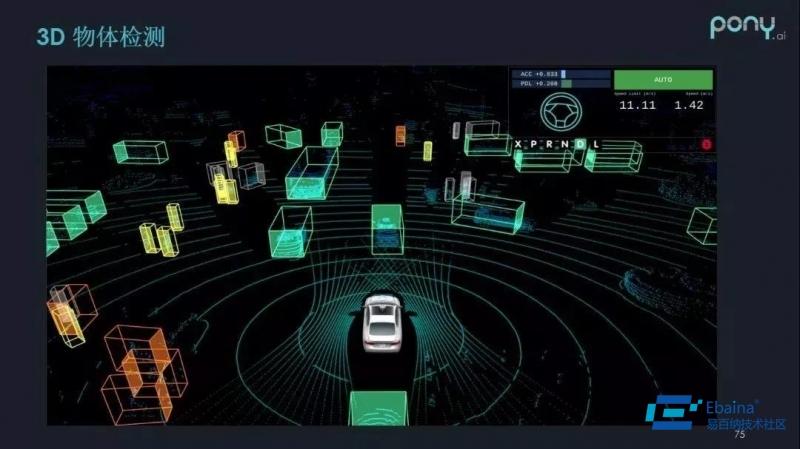

- 自動駕駛和機器人技術:

- 在自動駕駛領域,SAM可以用于道路和交通標志的分割,幫助車輛更好地理解周圍環(huán)境。

- 在機器人領域,SAM可以用于機器人視覺系統(tǒng)中,實現(xiàn)對物體的精準識別和抓取。

- 創(chuàng)意設計和廣告:

- 在廣告設計中,SAM可以用于快速分割圖像中的元素,以創(chuàng)建更具吸引力的廣告素材。

- 在創(chuàng)意設計中,SAM可以用于圖像合成、拼貼等任務,為設計師提供便捷的工具。

通過深思熟慮的合作實現(xiàn)負責任的人工智能

我們和其他人一樣,正在探索和發(fā)現(xiàn)人工智能的前沿。因此,在探索人工智能的眾多可能性時,我們也需要指導。通過傾聽主題專家、政策制定者和有生活經(jīng)驗的人的意見,我們旨在積極推動和推進人工智能系統(tǒng)的負責任設計和運營。在此過程中,我們堅持組織的核心原則:隱私和安全、公平和包容、穩(wěn)健性和安全性、透明度和控制、問責制和治理。

在行業(yè)活動中分享我們的進展

全年,我們以贊助商或主辦方的身份,通過各種虛擬、現(xiàn)場和混合行業(yè)和學術活動與 AI 社區(qū)建立聯(lián)系。在這些活動中,我們的工程師和研究人員分享了我們最新的產(chǎn)品開發(fā)、研究突破和出版物。

導師計劃:獲得人工智能研究的實踐經(jīng)驗

我們熱衷于向人們介紹非凡的 AI 世界。我們的 AI 導師制 (AIM) 和 EMEA 計劃讓博士候選人與其大學、學術顧問和 Meta 的 AI 導師(作為 Meta 的全職 AI 員工)合作開展開放科學研究。我們目前已與美國、法國、以色列和英國的知名大學達成協(xié)議。

通過深思熟慮的合作實現(xiàn)負責任的人工智能

我們和其他人一樣,正在探索和發(fā)現(xiàn)人工智能的前沿。因此,在探索人工智能的眾多可能性時,我們也需要指導。通過傾聽主題專家、政策制定者和有生活經(jīng)驗的人的意見,我們旨在積極推動和推進人工智能系統(tǒng)的負責任設計和運營。在此過程中,我們堅持組織的核心原則:隱私和安全、公平和包容、穩(wěn)健性和安全性、透明度和控制、問責制和治理。

在行業(yè)活動中分享我們的進展

全年,我們以贊助商或主辦方的身份,通過各種虛擬、現(xiàn)場和混合行業(yè)和學術活動與 AI 社區(qū)建立聯(lián)系。在這些活動中,我們的工程師和研究人員分享了我們最新的產(chǎn)品開發(fā)、研究突破和出版物。

導師計劃:獲得人工智能研究的實踐經(jīng)驗

我們熱衷于向人們介紹非凡的 AI 世界。我們的 AI 導師制 (AIM) 和 EMEA 計劃讓博士候選人與其大學、學術顧問和 Meta 的 AI 導師(作為 Meta 的全職 AI 員工)合作開展開放科學研究。我們目前已與美國、法國、以色列和英國的知名大學達成協(xié)議。