Stable Diffusion Agent 開發:技術解析與應用前景

GLiDE框架的提出,不僅是對傳統語言模型的一次突破,更是為機器人與人類更自然的互動提供了可能。通過分析反事實擾動,GLiDE可以在不直接依賴手動定義技能的情況下,生成適應性強的任務計劃。這意味著,在沒有明確指明具體步驟的情況下,機器人也能通過語言指令執行復雜任務。

這種創新不僅提升了智能對話機器人的操作能力,也為未來更多的語言與行動結合的研究提供了新的方向。GLiDE框架通過反事實擾動生成的計劃,能夠適應不同的任務環境和需求,從而為機器人執行復雜任務提供了新的思路。

在文本條件圖像生成領域,GLiDE同樣展現了其強大的能力。擴散模型最近被證明可以生成高質量的合成圖像,特別是在結合引導技術后,能夠在犧牲多樣性來換取更高保真度的情況下,生成逼真的圖像。利用GLiDE框架,這些圖像的生成變得更為高效且具有更高的語義合理性。

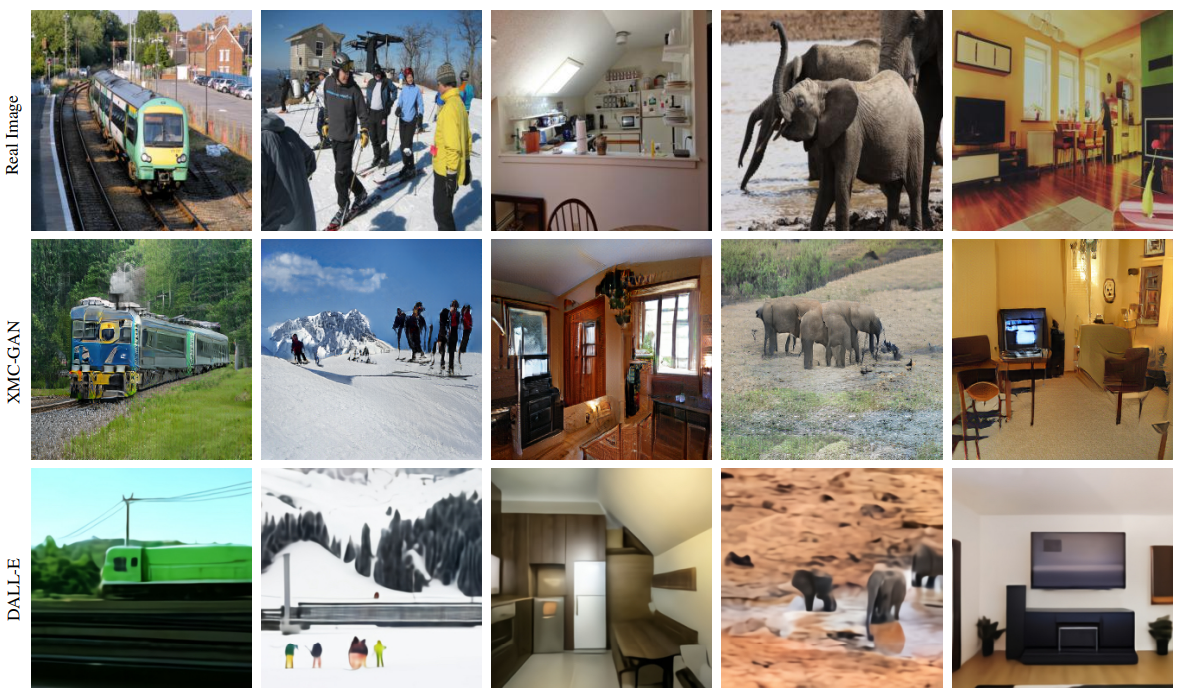

在圖像生成中,GLiDE模型通過無分類器指導能夠生成更高質量的圖像樣本。相比于使用CLIP重新排序的DALL-E樣本,GLiDE生成的圖像在真實感和字幕相似性方面更受人類評估者的青睞。

GLiDE的方法論涉及多個方面,包括64×64分辨率訓練的35億參數文本條件擴散模型,以及另一個15億參數文本條件上采樣擴散模型。通過這些模型,GLiDE能夠以文本為條件生成高質量的圖像,并通過微調支持無條件圖像生成。

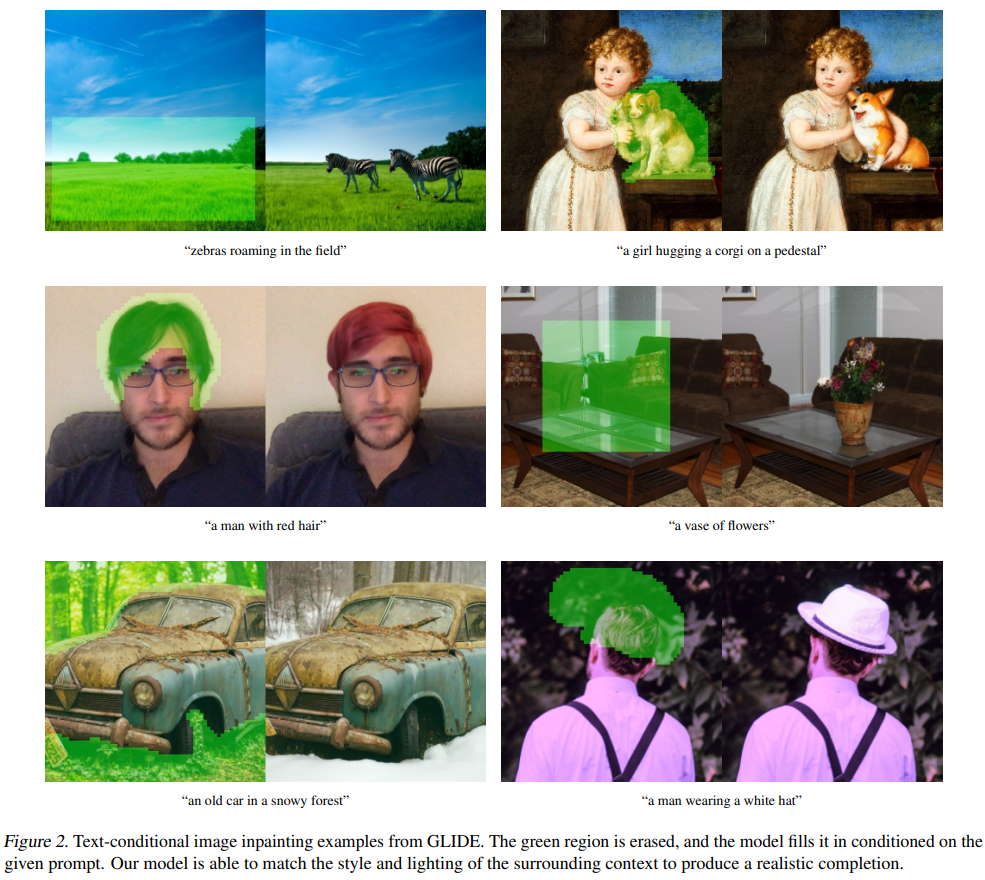

在圖像繪畫任務中,GLiDE通過對模型的微調,能夠在采樣過程中處理噪聲和上下文不一致的問題。這使得模型能夠在采樣后更好地匹配圖像的已知區域,從而生成更精確的圖像修復結果。

在實驗中,GLiDE展示了其在圖像生成與修復方面的突出表現。通過對比不同模型的生成結果,GLiDE展現了其獨特的優勢。例如,在MS-COCO提示上的隨機圖像樣本中,GLiDE能夠在沒有CLIP重新排序或挑選的情況下,生成高質量的圖像。

盡管如此,GLiDE也有其局限性。例如,在處理非常不尋常的對象或場景時,模型可能無法完全捕捉描述的所有細節。同時,GLiDE的采樣過程耗時較長,這也是當前許多擴散模型面臨的共同挑戰。

GLiDE的出現,為智能對話機器人在實際應用中的發展提供了新的可能。通過將語言計劃與機器人演示結合,機器人能夠更好地理解復雜的指令,并在不同情境下執行相應的任務。

這種能力不僅提升了機器人的自動化水平,也使其在各種場景中具有更高的適應性。無論是家庭助手還是工業自動化,GLiDE在智能對話機器人中的應用前景都十分廣闊。

GLiDE框架的提出,為智能對話機器人在語言理解與行動執行上的結合提供了新的可能。通過反事實擾動與演示的結合,GLiDE不僅提升了語言模型的實用性,也為未來更多的研究方向提供了參考。

在未來,隨著計算能力的提升和算法的優化,GLiDE有望在更多領域中得到應用,為人類與機器人之間的溝通與協作搭建更為自然的橋梁。

問:GLiDE框架的核心優勢是什么?

問:GLiDE在圖像生成中有什么突破?

問:GLiDE在智能對話機器人中有哪些應用前景?