PixVerse V3 API Key 獲取:全面指南與實踐

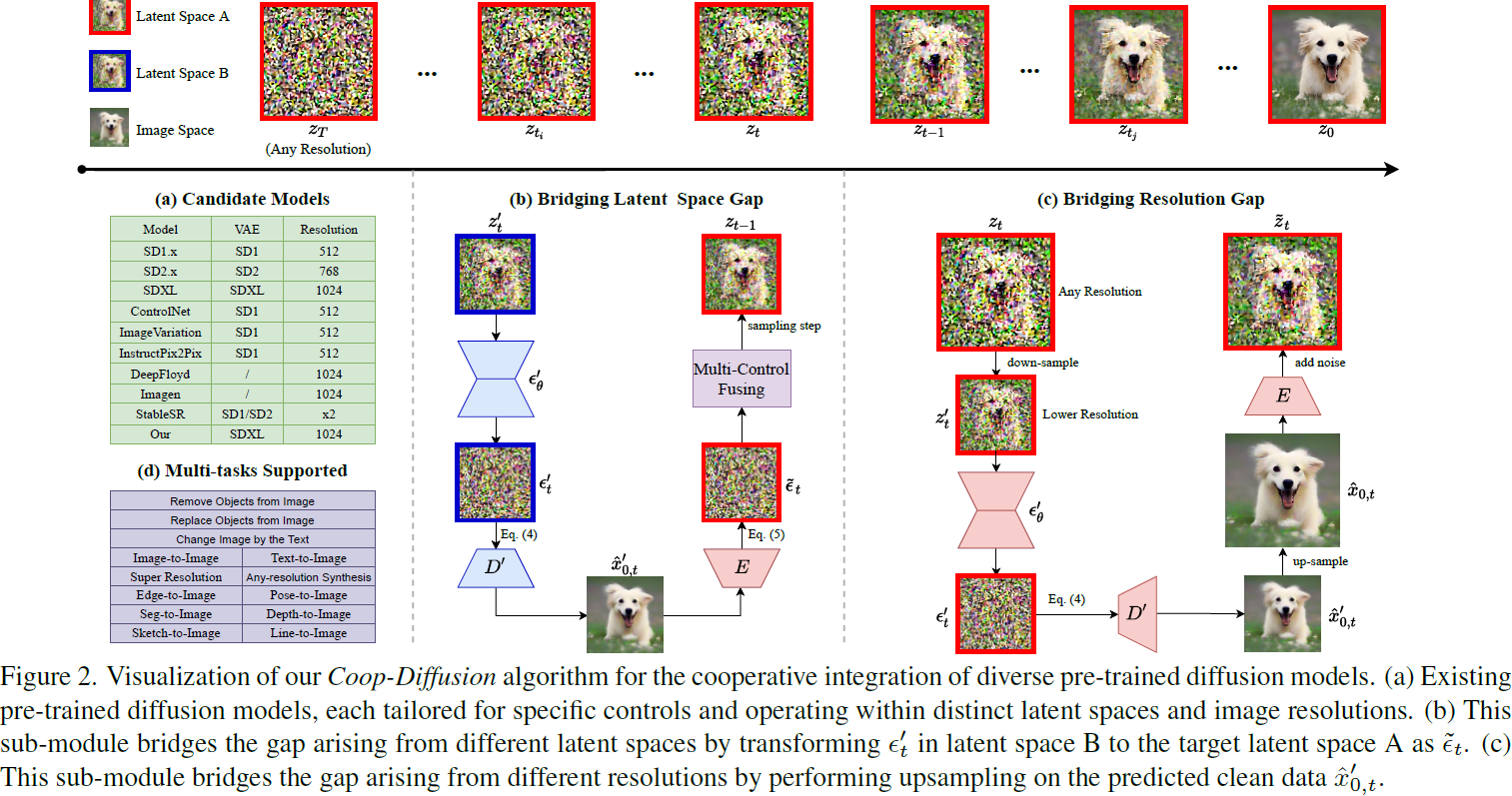

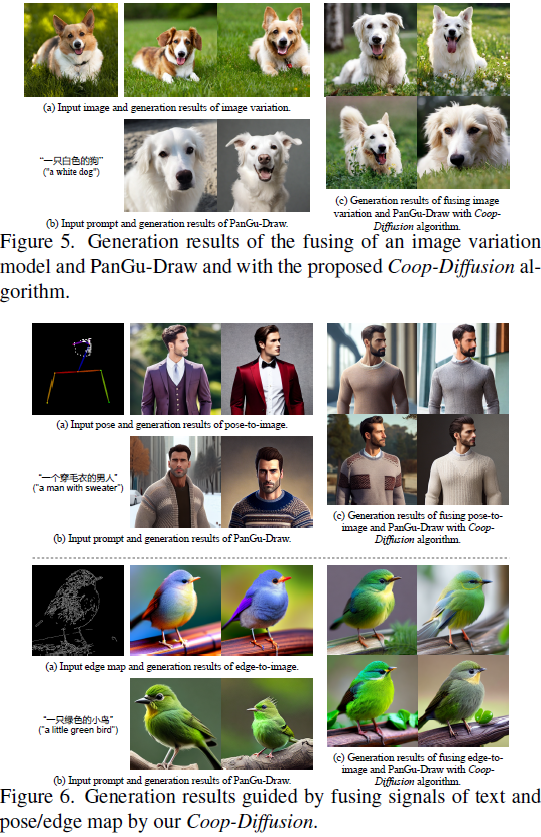

PanGu-Draw 不僅能夠適應多個控制信號,還對實現無縫的多控制圖像合成提供了新的解決方案。通過優化算法,PanGu-Draw 可在不同的潛在空間和分辨率中高效運行。這使得該模型在減少數據準備和訓練資源方面展示了極大的潛力。

時間解耦訓練策略是 PanGu-Draw 的核心創新之一。它通過將文本到圖像模型分為結構生成器和紋理生成器兩部分,從而大大降低了訓練復雜性。每個生成器負責不同時間段的處理:結構生成器在去噪的初期階段構建圖像的基本結構,而紋理生成器則在后期對圖像進行細節上的精細化處理。通過這一策略,PanGu-Draw 實現了資源的高效利用,降低了訓練成本。

傳統的模型通常因為需要高分辨率圖像而丟棄低分辨率數據,從而浪費了大量潛在的訓練素材。PanGu-Draw 通過結合使用不同分辨率的圖像,避免了這種浪費。這種結合不僅提升了數據利用率,而且沒有損失模型的預測性能。這一策略在實驗中展示了其卓越的數據效率,為訓練大規模模型提供了新的思路。

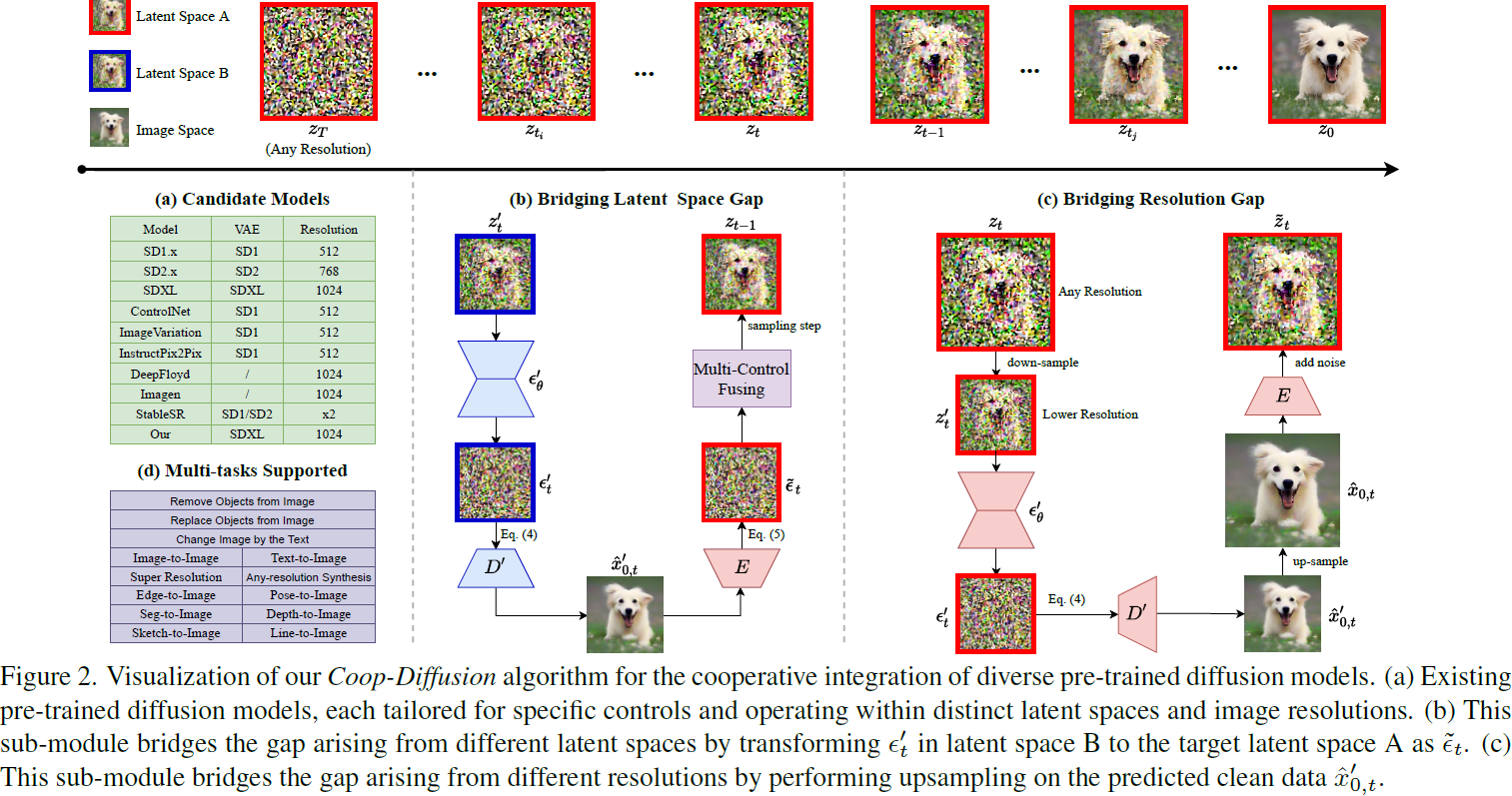

在圖像生成領域,不同的擴散模型通常具有不同的潛在空間和分辨率。這使得這些模型的聯合使用變得困難。然而,PanGu-Draw 的 Coop-Diffusion 算法通過彌合潛在空間和分辨率的差距,成功實現了多模型的協同工作。

在彌合潛在空間的挑戰中,PanGu-Draw 使用圖像空間作為中間步驟,將模型預測從一個潛在空間轉換到另一個。具體而言,通過解碼器和編碼器的協作,模型預測的噪聲被有效轉換。這一過程中,保持了模型預測的準確性和穩定性。

傳統的上采樣方法容易導致圖像中的偽影問題。PanGu-Draw 提出了新的上采樣算法,確保在不同分辨率的模型去噪過程中保持獨立同分布的假設。通過中間圖像空間的使用,PanGu-Draw 在高效上采樣的同時,避免了常見的偽影問題。

在多項實驗中,PanGu-Draw 展示了其在多控制和多分辨率圖像生成任務中的強大能力。自動評估結果表明,PanGu-Draw 的性能優于現有的最先進模型。此外,在人工評估中,PanGu-Draw 的生成質量與最先進的模型相當甚至更好。

通過消融研究,時間解耦訓練策略的有效性得到了進一步驗證。研究表明,僅使用低分辨率圖像進行訓練并不會對模型的性能產生負面影響。此外,當去噪時間步超過 500 時,模型表現最佳。這一發現為未來的模型優化提供了重要的啟示。

使用 PanGu-Draw 進行圖像合成相對簡單。用戶可以通過以下步驟搭建起一個完整的系統:

import os

import numpy as np

import onnx

import onnxruntime as ort

import matplotlib.pyplot as plt

input_data_dir = 'input_data'

output_data_dir = 'output_data'

input_upper = np.load(os.path.join(input_data_dir, 'input_upper.npy')).astype(np.float32)

input_surface = np.load(os.path.join(input_data_dir, 'input_surface.npy')).astype(np.float32)

output_upper = np.load(os.path.join(output_data_dir, 'output_upper.npy')).astype(np.float32)

output_surface = np.load(os.path.join(output_data_dir, 'output_surface.npy')).astype(np.float32)通過這些代碼,用戶可以輕松地導入模型預測結果,并繪制出全球氣溫、地表溫度、重力位勢和風速圖。

PanGu-Draw 在生成多樣化和高質量的圖像方面展現了顯著的優勢。通過對多個控制信號的支持,用戶可以生成不同分辨率和風格的圖像,滿足不同的應用場景需求。

PanGu-Draw 通過創新的時間解耦訓練策略和 Coop-Diffusion 算法,顯著提升了文本到圖像合成的資源效率。其在多控制和多分辨率圖像生成中的卓越表現,為未來的圖像合成技術提供了新的可能性。未來,PanGu-Draw 有望在更多實際應用中得到廣泛應用。

問:PanGu-Draw 與傳統圖像合成模型的主要區別是什么?

問:如何開始使用 PanGu-Draw 進行圖像合成?

問:PanGu-Draw 的應用場景有哪些?

問:Coop-Diffusion 如何解決不同模型間的分辨率差距?

問:PanGu-Draw 能否在低資源環境中運行?