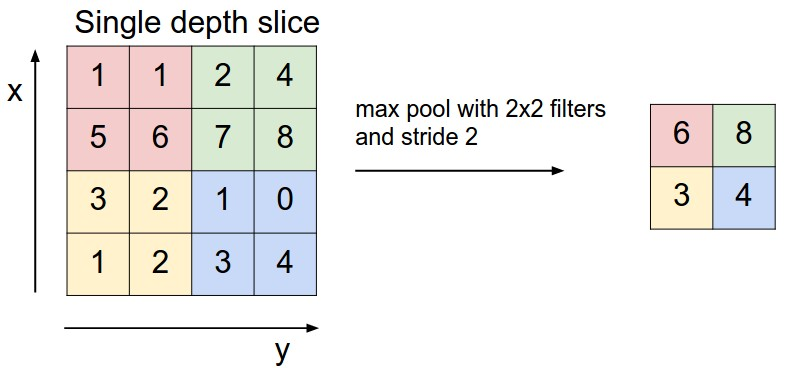

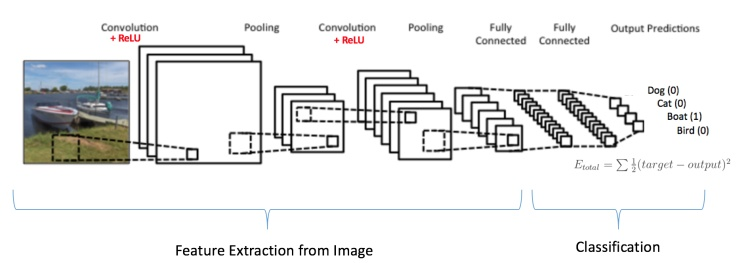

CNN的基本結構

CNN的基本結構包括卷積層、激活層、池化層和全連接層。以LeNet-5為例,輸入由多種通道構成的圖像數據,經過多重卷積、池化和激活后,特征被提取出來,再通過全連接層輸出。

卷積層的作用

卷積層通過濾波器提取圖像的局部特征。每個濾波器對應一個特征圖,多個濾波器生成多個特征圖,這些特征圖在深度方向堆疊形成輸出。

感受野、濾波器和卷積

感受野可以理解為神經元看到的視野。在CNN中,每個神經元只感受局部圖像區域、提取局部特征,然后在更高的層次上匯總起來,形成對整個圖像的認識。卷積則是通過點積形式的數學運算提取局部特征。

步幅和填充

步幅(stride)是卷積窗滑動的單位,填充(padding)則是在圖像邊界加上一圈0,以擴展圖像邊界。填充的量可以通過公式計算得出,以確保輸入輸出尺寸相等。

激活層

激活層通常使用ReLU函數,引入非線性特征,增強模型的表達能力。同時,ReLU函數可以避免梯度消失的問題,加快收斂速度。

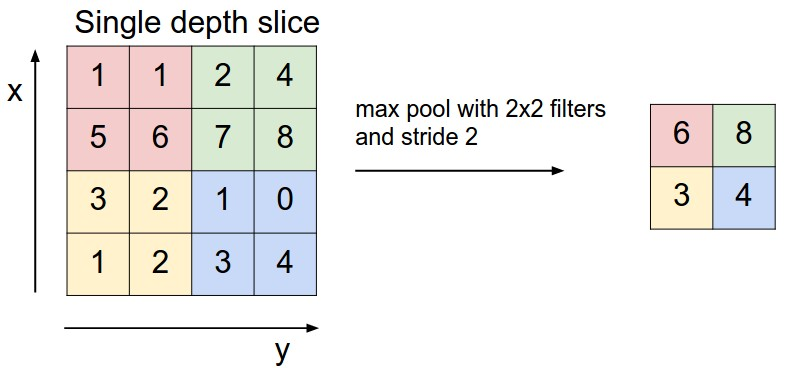

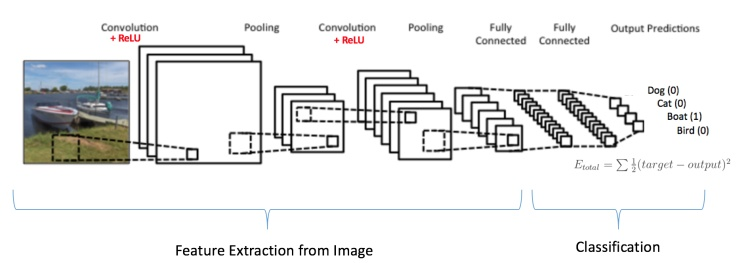

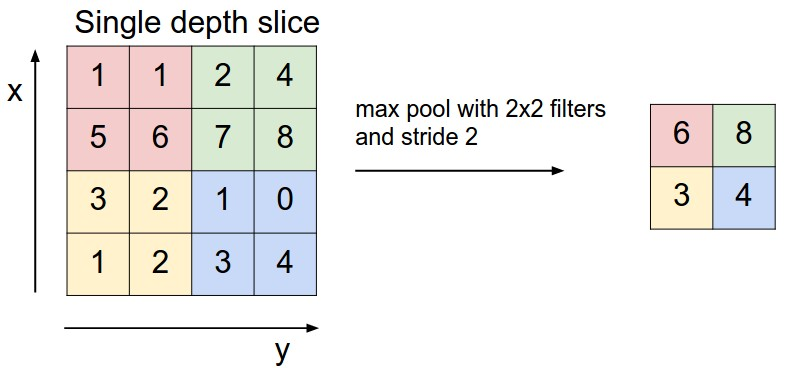

池化層

池化層通過抽象特征的過程來保留特征的同時減少參數。最大池化(max-pooling)是常用的池化方法,它取每個小區域中的最大值作為代表。

光柵化

光柵化是將特征圖中的像素依次取出,排列成一個向量,為全連接層的輸入做準備。

全連接層

全連接層將局部特征整合起來,進行分類。例如,找到了老鼠的屁股、眼睛和胡須等特征后,全連接層將這些特征綜合起來,判斷出這是一個老鼠。

訓練網絡

CNN的訓練過程包括不斷卷積提取特征、前向傳播暫定網絡參數,反向傳播更新參數,以達到在訓練集上loss最小,在測試集上模型的準確率更高。

技巧和策略

為了更好更快地訓練出好的模型,我們使用了一些技巧,如批量正則化(batch normalization)、隨機失活(dropout)和圖像增廣(image augmentation)。

寫在最后

本文詳細介紹了CNN在圖像領域的基本應用原理,希望能夠幫助大家更好地理解和應用CNN。

FAQ

-

問:CNN為什么在圖像識別中效果這么好?

答:CNN通過模擬人腦處理圖像的方式,逐層提取圖像特征,每一層都對圖像有更深入的理解,從而在圖像識別中取得很好的效果。

-

問:卷積層和全連接層有什么區別?

答:卷積層主要負責提取局部特征,而全連接層則負責將這些局部特征整合起來,進行最終的分類判斷。

-

問:ReLU激活函數有什么優點?

答:ReLU激活函數可以引入非線性特征,增強模型的表達能力,同時避免梯度消失的問題,加快收斂速度。

-

問:池化層的作用是什么?

答:池化層的作用是在保留特征的同時減少參數量,降低過擬合的風險,同時實現圖像的不變性。

-

問:如何選擇合適的CNN架構?

答:選擇CNN架構時,需要考慮任務的復雜性、數據集的大小和計算資源等因素。可以參考已有的經典架構,如LeNet、AlexNet等,根據實際情況進行調整。

熱門推薦

一個賬號試用1000+ API

助力AI無縫鏈接物理世界 · 無需多次注冊

3000+提示詞助力AI大模型

和專業工程師共享工作效率翻倍的秘密

熱門推薦

一個賬號試用1000+ API

助力AI無縫鏈接物理世界 · 無需多次注冊

国内精品久久久久影院日本,日本中文字幕视频,99久久精品99999久久,又粗又大又黄又硬又爽毛片

丁香婷婷综合五月|

国产欧美精品区一区二区三区

|

懂色av噜噜一区二区三区av|

欧美高清www午色夜在线视频|

555夜色666亚洲国产免|

亚洲欧洲av色图|

亚洲v精品v日韩v欧美v专区|

91精品国产一区二区三区|

成人免费电影视频|

日韩和欧美一区二区三区|

99久久精品情趣|

日韩伦理免费电影|

欧美不卡一区二区三区|

精品一区二区影视|

色狠狠一区二区|

国产成人亚洲综合色影视|

日本成人超碰在线观看|

一区二区三区高清在线|

91精品在线观看入口|

国产最新精品免费|

亚洲精品久久久久久国产精华液|

91片在线免费观看|

中文字幕一区二区三区视频|

日韩理论片网站|

久久久www免费人成精品|

欧美一卡二卡在线|

91年精品国产|

成人三级伦理片|

麻豆精品一二三|

亚洲日本中文字幕区|

国产亚洲欧美色|

日韩欧美不卡一区|

色婷婷综合久久久久中文一区二区|

国产美女在线精品|

在线影院国内精品|

欧美日韩国产美|

欧美性生活一区|

国产成人福利片|

色综合天天综合狠狠|

日韩1区2区3区|

国产日产精品1区|

久久国产人妖系列|

99久久精品国产一区|

国产成人亚洲综合色影视|

岛国精品在线播放|

欧美日韩精品一区视频|

proumb性欧美在线观看|

色诱视频网站一区|

成人黄色电影在线|

日韩欧美一级二级三级|

中文字幕精品一区二区三区精品|

亚洲视频一区二区免费在线观看|

色婷婷久久久久swag精品|

精品理论电影在线|

另类调教123区|

欧美伦理影视网|

亚洲欧美日韩系列|

欧美精品粉嫩高潮一区二区|

亚洲午夜一区二区|

风间由美性色一区二区三区|

色吧成人激情小说|

蜜臀av性久久久久蜜臀aⅴ流畅|

欧美视频三区在线播放|

亚洲欧美国产77777|

www.在线欧美|

亚洲国产成人在线|

国产91对白在线观看九色|

91在线观看免费视频|

亚洲在线视频网站|

日韩一区二区三区四区|

99免费精品视频|

亚洲精品一卡二卡|

激情综合色综合久久综合|

av电影在线观看完整版一区二区|

亚洲一二三四久久|

国产亚洲1区2区3区|

欧美在线视频日韩|

韩国欧美国产1区|

国产精品二三区|

亚洲成av人片|

欧美在线视频你懂得|

日韩不卡一二三区|

欧美裸体一区二区三区|

91黄视频在线观看|

51久久夜色精品国产麻豆|

成人一区在线看|

免费高清视频精品|

久久久久久9999|

777久久久精品|

韩国欧美国产一区|

国产尤物一区二区|

欧美精品少妇一区二区三区|

欧美一级片免费看|

91精品福利在线|

欧美影院一区二区|

欧美专区亚洲专区|

色综合咪咪久久|

国产在线视频一区二区|

欧美日韩一区在线|

国产夜色精品一区二区av|

中文字幕一区三区|

国产精品国产三级国产aⅴ入口|

成人国产精品免费网站|

99热精品一区二区|

国产一区中文字幕|

国产日韩欧美a|

亚洲成人中文在线|

暴力调教一区二区三区|

欧美精品高清视频|

久久亚洲一区二区三区明星换脸|

欧美性videosxxxxx|

中文字幕色av一区二区三区|

国产不卡视频在线播放|

欧美一区二区三区在线观看|

久久久精品综合|

国产精品一二一区|

午夜影院久久久|

日本黄色一区二区|

久久九九99视频|

亚洲色图丝袜美腿|

99精品国产91久久久久久

|

欧美96一区二区免费视频|

日本不卡免费在线视频|

色婷婷久久99综合精品jk白丝|

亚洲欧美视频一区|

91麻豆精品91久久久久久清纯|

美国av一区二区|

欧美在线一区二区三区|

日本欧美韩国一区三区|

国产不卡视频一区二区三区|

国产成人在线视频播放|

一区二区三区欧美亚洲|

日韩欧美不卡在线观看视频|

色婷婷久久综合|

99热精品国产|

成人免费精品视频|

成人激情动漫在线观看|

日本欧美一区二区|

精品国产91九色蝌蚪|

欧美在线观看视频一区二区|

国产成人无遮挡在线视频|

国产成人av资源|

成人久久视频在线观看|

懂色av一区二区三区蜜臀|

国产91富婆露脸刺激对白|

久久99精品国产麻豆婷婷洗澡|

视频一区视频二区在线观看|

亚洲欧美日韩国产另类专区

|

日韩国产在线一|

gogogo免费视频观看亚洲一|

日韩欧美123|

亚洲欧美日韩中文播放|

av激情综合网|

中文字幕一区三区|

99久久国产综合精品女不卡|

精品国产乱码久久久久久图片|

正在播放亚洲一区|

成人av资源站|

精品国产乱码久久久久久图片|

自拍偷拍亚洲激情|

国产一区不卡视频|

91久久精品日日躁夜夜躁欧美|

欧美亚洲高清一区二区三区不卡|

www.亚洲免费av|

国产亚洲制服色|

久久精品免费观看|

在线国产亚洲欧美|

亚洲日本青草视频在线怡红院|

日韩av网站免费在线|

欧美日韩在线不卡|

天堂蜜桃91精品|

欧美精品自拍偷拍|

丝袜美腿一区二区三区|

在线亚洲精品福利网址导航|

最新日韩av在线|

thepron国产精品|

中文字幕不卡一区|

菠萝蜜视频在线观看一区|

自拍视频在线观看一区二区|

成人激情开心网|

亚洲v日本v欧美v久久精品|

另类小说视频一区二区|

精品日韩成人av|

国产日韩视频一区二区三区|

99国产精品久|

99免费精品视频|

激情成人综合网|

国产精品入口麻豆原神|

欧美二区三区的天堂|

粉嫩绯色av一区二区在线观看|

不卡视频在线观看|

免费成人av在线播放|

国产精品国产三级国产|

国产日本欧美一区二区|

欧美日韩国产色站一区二区三区|

欧美日韩亚洲综合一区二区三区|

成人欧美一区二区三区|

亚洲一区在线观看免费

|

亚洲综合一区二区三区|

欧美一区二区免费|