文心一言寫代碼:代碼生成力的探索

通過這種方法,可以在國產大模型中實現自動函數調用,進一步增強了模型的實用性。該方法的核心是通過提示工程,結合 Semantic Kernel 的本地函數調用原理,實現兼容性。

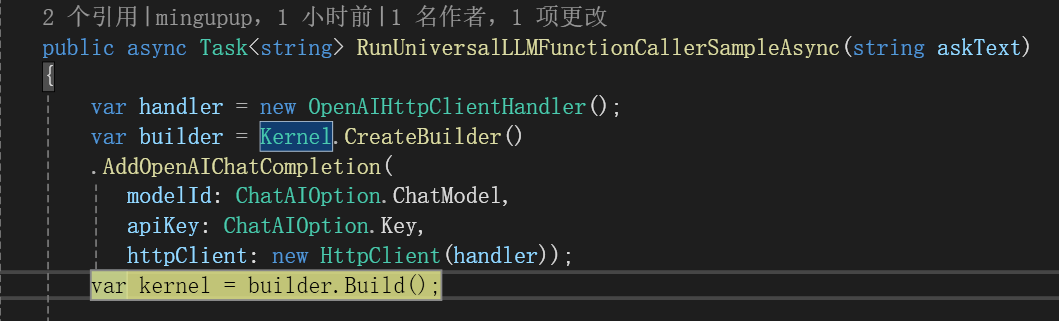

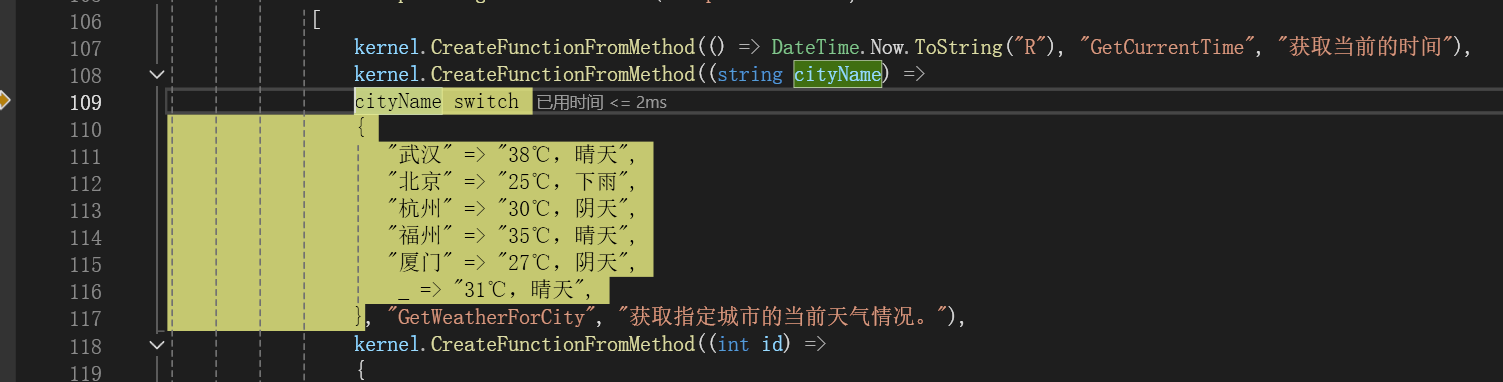

在應用 Function Calling 的過程中,我們可以觀察到其在增強模型能力方面的顯著效果。例如,使用 Qwen2-7B-Instruct 模型進行測試時,我們可以創建一個 Kernel 來加載必要的插件,然后通過文本轉換和對話歷史的加入,逐步實現函數調用。

// 創建 Kernel

var kernel = new Kernel();

// 導入插件

kernel.ImportPlugin("MyPlugin");

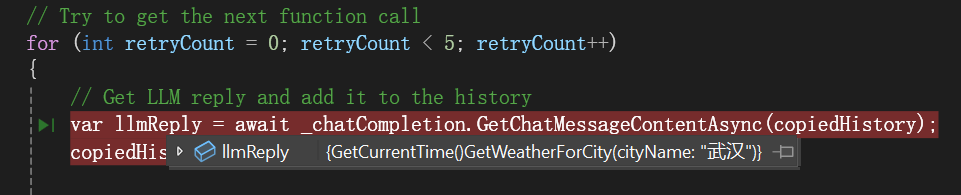

在這個過程中,我們首先將插件轉換為文本格式,并將其嵌入到 Prompt 中。然后,我們在對話歷史中添加示例和指令,指導 LLM 選擇應調用的函數。最后,通過驗證和調用插件中的函數,完成任務。

這種方法經過多次測試,證明在多個大型語言模型(LLM)中都可以使用。例如,硅基流動、訊飛星火、零一萬物等平臺的多種模型都支持這種方法。通過測試,我們可以看到 Function Calling 的有效性和各個模型的兼容性。

| 平臺 | 可用模型 |

|---|---|

| 硅基流動 | Llama-3.1-405/70/8B 等 |

| 訊飛星火 | Spark Lite 等 |

| 零一萬物 | yi-large、yi-medium 等 |

騰訊云最近推出了模型管理和智能體評測模塊,通過這些模塊,用戶可以選擇不同種類的模型并進行性能監控和微調。模型管理支持文本模型、多模態模型等,用戶可以根據需求選擇適合的模型類型和功能。

通過微調,用戶可以基于基座大模型構建自己的微調數據集,訓練出適合特定領域的專業大模型。這種更新對于構建垂直智能體非常有意義。

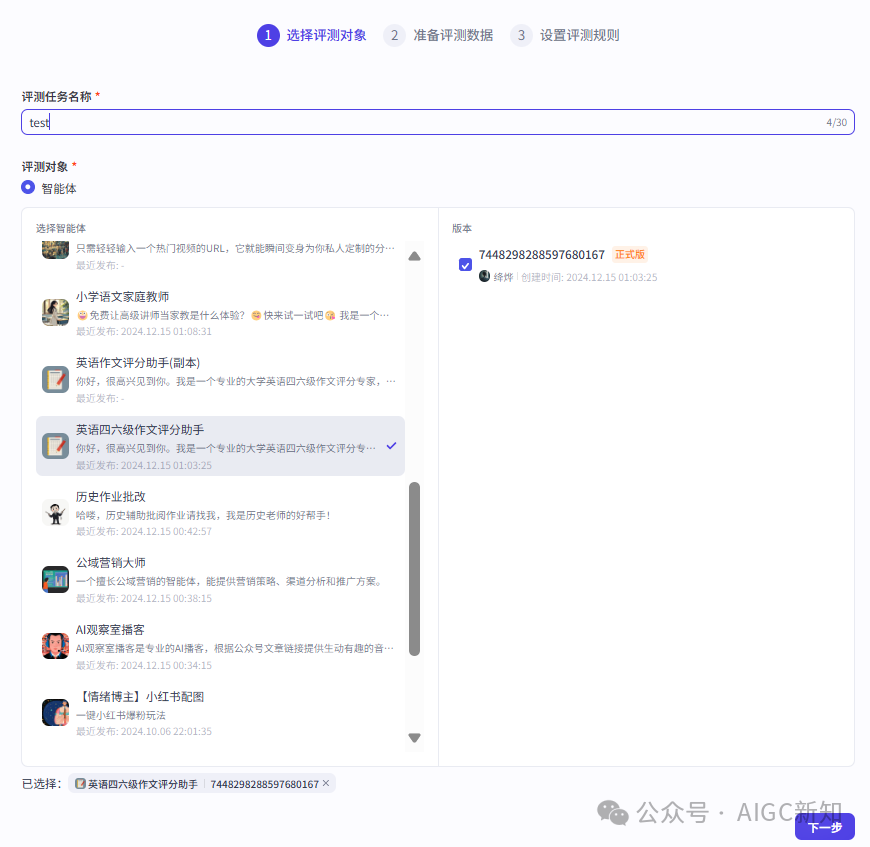

騰訊云的智能體評測通過構建領域評測數據集和設置不同的評估規則,幫助用戶驗證智能體的效果。用戶可以選擇評測對象,準備評測數據集,并進行多維度的評測。

問:什么是 Function Calling?

問:如何在國產大模型中實現 Function Calling?

問:騰訊云的模型管理模塊有哪些功能?

通過本文的介紹,相信讀者對基于 MiniMax-abab6.5s 的 RAG 系統和 Function Calling 方法有了更深入的理解。這些技術的應用將為 AI 助手和智能體的開發帶來更大的靈活性和功能擴展。